こんにちは。AX研究室のRobert Hubaczです。

Physics-Informed Neural Networks(PINN)は、物理現象の問題を解くために用いられるニューラルネットワークの一種です。機械学習と物理方程式を組み合わせることで、ネットワークはデータだけでなく、物理法則からも学習します。

このため、PINNは利用できるデータが少ないデータでも精度よく学習できる場合があります。また、物理法則に反するような不自然な結果を出しにくいという利点もあります。

しかし、PINNには重要な制約もあります。まず、PINNの学習には時間がかかることがあります。さらに、従来型のPINNは、問題の物理パラメータが変化すると、通常は学習し直さなければなりません。ここでいう物理パラメータとは、速度、温度、濃度、あるいは問題を解析する領域の大きさのような量を指します。言い換えると、あるパラメータ条件で学習したPINNは、別のパラメータ条件に対する解をそのまま予測することは一般にはできません。

この点は、流体の流れを例にするとわかりやすくなります。流体の流れは Navier–Stokes方程式で表されます。数値シミュレーションでは、これらの方程式はしばしばより簡単な無次元形に書き換えられます。この形では、重要な物理パラメータの1つがレイノルズ数(Re)です。この数は、流体の性質、流速、形状などに依存します。たとえば、流速が大きくなるほど、あるいは形状が大きくなるほど、一般にレイノルズ数は大きくなります。多くの場合、レイノルズ数だけで異なる流れ条件を区別することができます。

レイノルズ数は、どのような種類の流れが生じるかを理解する助けになります。流れが滑らかで安定した層流になりやすいのか、それともより複雑で乱れた乱流になりやすいのかを示してくれます。ある種類の流れに対してうまく働く解法が、別の種類の流れに対してもうまく働くとは限りません。

しかし、PINNにはさらに重要な制約があります。標準的な PINNは、通常、ある1つの特定のレイノルズ数に対してのみ学習されます。つまり、流れの性質がそれほど大きく変わらない場合であっても、あるレイノルズ数で学習したモデルを、別のレイノルズ数にそのまま使うことは一般にはできません。

そのため、多くの場合、PINNは再学習が必要になります。

つまり、この投稿のポイントは、物理パラメータが変わるたびにPINNを学習し直さなくてよい方法があるのか、という点です。

この投稿では、次の 3 つのアプローチを比較します。

- Traditional PINN(従来型PINN)— 1つのケースに対して1つのモデル

- Parameterized PINN(パラメータ化PINN) — 複数のパラメータ値に対して1つのモデル

- Meta-learning PINN(メタラーニングPINN)— 新しいケースにより速く適応できるモデル

この投稿の目的は、これらのアプローチがどのように異なるのか、そして物理パラメータが変化したときに、再学習を完全に回避できるのか、それとも必要な再学習の量を減らすだけなのかを説明することです。これをわかりやすくするために、以下では、レイノルズ数を唯一の物理パラメータとした流体流れ予測用のPINNを例として用います。

方法1 — Traditional PINN

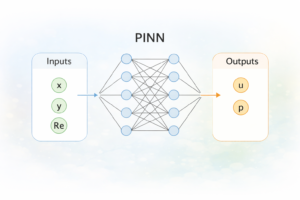

図1。Traditional PINN。ここで、xとyは空間座標、uとpはxとyに依存する速度と圧力の値です。

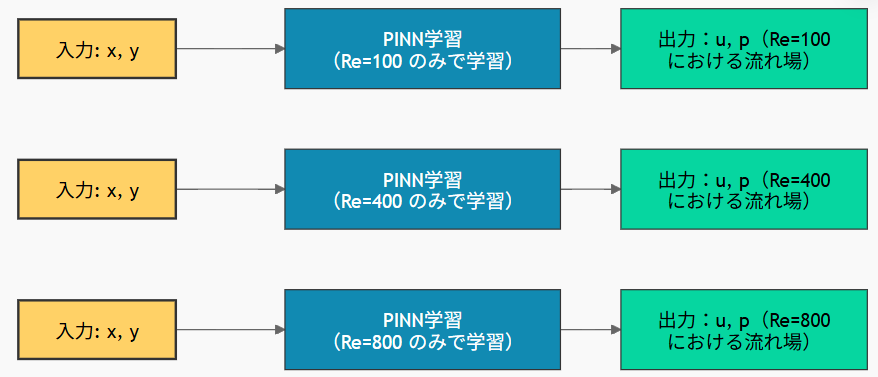

最も単純な方法は、レイノルズ数ごとに別々のニューラルネットワークを学習することです。

例:

PINN_100 → Re=100用に学習PINN_400 → Re=400用に学習

PINN_800 → Re=800用に学習

このモデルは、ある固定されたReの値に対してのみ、流速と圧力が位置にどう依存するかを学習します。

(x, y) → (u, p)

各ネットワークは、1つの特定のケースに対するNavier–Stokes方程式の解を学習します。したがって、Reの値が変わると、PINNは再学習が必要になります。

利点

✔ 実装が簡単

✔ 安定していて高い精度が得られやすい

欠点

❌ パラメータ値ごとに再学習が必要

❌ 計算コストが高い

❌ ある流れ条件で得た知識を、別の流れ条件に活かせない

方法2 — Parameterized PINN

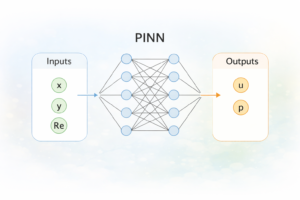

図2。Parameterized PINN。ここで、xとyは空間座標、Reはレイノルズ数、uとpは x、y、Reに依存する速度と圧力の値です。

Parameterized PINNとは、異なるパラメータ値によって定義される複数の関連する物理問題に対して、1つのモデルで解を予測する方法です。

従来型の PINNでは空間座標だけを入力しますが、Parameterized PINNでは、レイノルズ数のような物理パラメータも入力に加えます。

例:

Input: (x, y, Re)

Output: (u, p)

このようにすることで、モデルは速度と圧力が位置だけでなくReの値によってどう変わるかも学習できます。

(x, y, Re) → (u, p)

学習と使い方

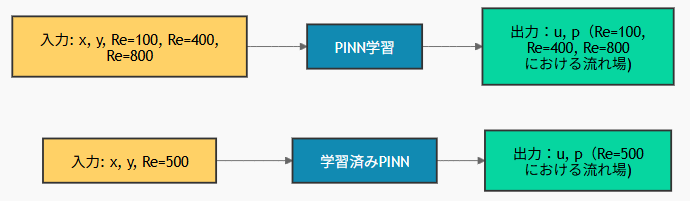

Parameterized PINNでは、モデルはRe=100、Re=400、Re=800のような異なるレイノルズ数によって定義される複数の流れケースを用いて学習されます。

そのため、学習後には、たとえば Re=500のような学習範囲内の新しい値に対して、追加学習なしで予測できる場合があります。

つまり、Parameterized PINNは、学習した範囲内であれば再学習を行わずに使える可能性がある方法です。

限界

ただし、学習した範囲の外にある値では、予測精度が低下することが一般的です。

また、学習したケースと大きく異なる流れには、そのまま対応できない場合があります。たとえば、滑らかな流れだけで学習したモデルは、より複雑な流れを正確に予測できない可能性があります。

利点

✔ 1つのモデルで複数の流れ条件を扱える

✔ 学習範囲内では、再学習を完全に回避できることが多い

✔ 異なる流れ同士の関係をネットワークが学習できる

欠点

❌ 学習がより難しくなる

❌ 学習範囲の外では精度が低下しやすい

❌ 追加のデータが必要になる場合がある

方法3 — Meta-Learning PINN

Parameterized PINNは、1つのモデルでの異なる条件に対応する解を直接予測しようとする方法です。

一方、Meta-learning PINNは、新しい条件に対して少ない追加学習で素早く適応できるようにする方法です。

つまり、再学習を完全になくす方法ではなく、学習し直しを速くする方法です。

代表的なメタラーニング手法として、MAMLとReptileがあります。これらの方法は、1つの最終的な解そのものを学習するのではありません。その代わりに、PINNが新しい類似問題にすばやく適応できるような良い初期重みを学習します。

簡単に言えば、モデルは「新しいが似た問題を、より速く学習し始める方法」を学びます。

学習プロセス

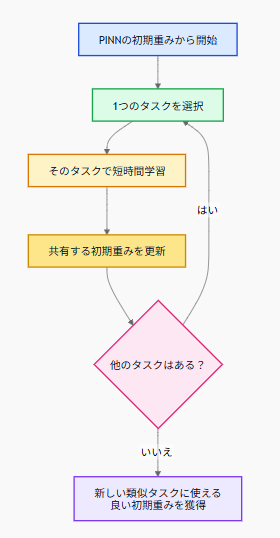

モデルは、多数の関連タスクで学習されます。各タスクは、たとえばRe=100、Re=400、Re=800といった異なるレイノルズ数に対応します。タスクは複数ありますが、ニューラルネットワーク自体は1つであり、その初期重みのセットも1つだけです。これらの重みはすべてのタスクで共有されます。

各ステップでは、アルゴリズムが1つのタスクを選び、そのタスクでネットワークを短時間だけ学習させます。その後、共有された初期重みを更新します。このプロセスを何度も繰り返すことで、モデルは、新しい類似問題に対して PINN がすばやく解を見つけられるような初期重みを学習します。

図3。簡略化したMeta-Learning PINNアルゴリズム。

モデルの使い方

新しいレイノルズ数が現れたときは、次のように使います。

学習済みの初期重みから開始 → 少数ステップの追加学習を行う → 新しいレイノルズ数に対する解を予測する

つまり、Meta-learning PINN では、新しい条件に対して追加学習は必要です。

ただし、ゼロから長時間学習する代わりに、少数の追加学習ステップで済む場合があります。

利点

✔ 新しい条件への適応が速い

✔ 必要な学習反復回数を減らせる場合がある

✔ 多数の類似 PDE 問題を扱うときに有用

欠点

❌ 学習手順がより複雑

❌ 多数の学習タスクが必要

❌ 追加学習は依然として必要

どの方法が再学習を最も減らせるのか?

この 3 つの方法は、再学習の減らし方がそれぞれ異なります。

| 方法 | 再学習は必要か? | 基本アイデア |

|---|---|---|

| Traditional PINN | はい | ケースごとに新しいモデルを学習する |

| Parameterized PINN | 多くの場合不要 | パラメータを入力に含める |

| Meta-learning PINN | 少量なら必要 | すばやく適応できる初期状態を学ぶ |

Parameterized PINNとMeta-learning PINNの違いはシンプルです。

- Parameterized PINNは、1つのモデルで複数の異なる条件に対応する解を直接予測する方法です。

- Meta-learning PINNは、新しい条件に対して短い追加学習で対応しやすくする方法です。

そのため、再学習をできるだけ避けたいなら Parameterized PINN、

少しの再学習で新しい条件にすばやく適応したいなら Meta-learning PINN

と考えると分かりやすいです。

まとめ

Traditional PINNは、新しい条件ごとに再学習が必要です。

Parameterized PINNは、追加学習をできるだけ減らしたい場合に向いています。

Meta-learning PINNは、再学習を完全になくすことはできませんが、新しい条件への適応を速くできます。

参考文献

- A. Jangir, R. Clements, R. Goyal and G. Tabor (2026): A Parameterized Physics-Informed Neural Network Solver for the Navier–Stokes Equations Across Reynolds Numbers, arxiv:2602.04670v1

- E. Torres, J. Schiefer and M. Niepert (2025) : Adaptive Physics-Informed Neural Networks, arXiv:2503.18181v1

- X. Liu, X. Zhang, W. Peng, W. Zhou and W. Yao (2021): A novel meta-learning initialization method for physics-informed neural networks, arxiv:2107.10991v1